机器学习笔记5-支持向量机2:高维空间与核技巧,直面线性不可分问题

2024-01-18 18:25:47

大家好,我是[您的名字],欢迎来到机器学习笔记系列的第五篇。在上一次的文章中,我们讨论了支持向量机(SVM)的基本原理和线性可分问题的求解方法。今天,我们将继续讨论SVM,并深入研究它在处理线性不可分问题时的策略,即高维空间与核技巧。

1. 高维空间与线性可分性

在现实世界中,许多问题都是线性不可分的,这意味着数据无法在低维空间中被一条直线或超平面完全分开。例如,考虑一个二分类问题,其中数据点分布在二维平面上,并且两个类别的点相互交织。在这种情况下,无法找到一条直线将两个类别完全分开。

为了解决这个问题,SVM使用了一个巧妙的技巧,将数据从低维空间映射到更高维的空间中。在这个更高维的空间中,数据点可能变得线性可分,即可以找到一个超平面将两个类别完全分开。这种映射被称为高维映射 。

2. 核技巧

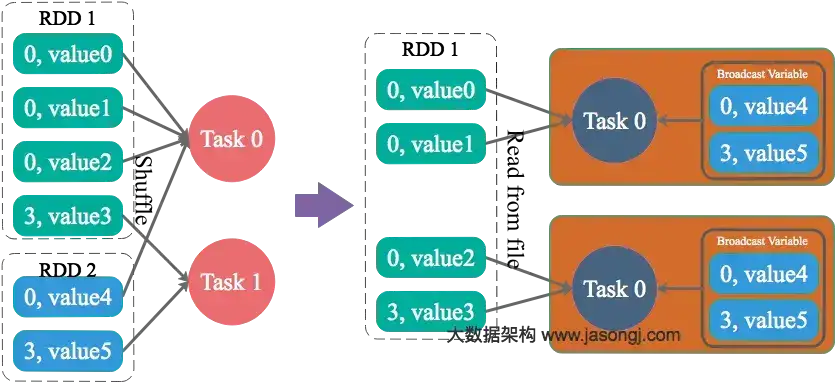

将数据映射到更高维的空间中可能会带来计算上的挑战,因为在高维空间中计算超平面的参数非常耗时。为了解决这个问题,SVM使用了一种叫做核技巧 的方法。核技巧允许我们在不显式地将数据映射到更高维空间的情况下进行计算。

核函数是一种将两个数据点映射到一个标量值的函数。这个标量值衡量了两个数据点之间的相似性。常用的核函数包括线性核、多项式核、高斯核等。

3. 支持向量机的对偶问题

SVM的原始问题是一个凸二次规划问题 ,求解起来比较困难。为了简化求解,我们可以将SVM的原始问题转换为其对偶问题 。对偶问题是一个凸二次规划问题 ,并且更容易求解。

在对偶问题中,我们将SVM的分类问题转换为一个求解一组拉格朗日乘子的问题。拉格朗日乘子是与SVM决策边界上数据点相对应的系数。通过求解对偶问题,我们可以得到SVM的决策边界和支持向量。

4. SVM的优势和局限性

SVM在处理线性可分问题时具有以下优势:

- 能够找到数据点之间的最佳分离超平面,从而提高分类精度。

- 对噪声和异常值具有鲁棒性,不容易受到干扰。

- 能够处理高维数据,并且随着数据维度的增加,分类精度不会明显下降。

SVM也存在一些局限性:

- 对于线性不可分的问题,SVM需要使用高维映射和核技巧,这可能会带来计算上的挑战。

- SVM对参数的选择比较敏感,需要根据具体问题进行参数调优。

- SVM不适合处理大规模的数据集,因为训练时间会随着数据量的增加而增加。

5. 总结

在今天的文章中,我们讨论了支持向量机在处理线性不可分问题时的高维空间与核技巧。我们介绍了高维映射的概念,以及如何使用核技巧简化高维空间中的计算。我们还探讨了支持向量机的对偶问题,以及SVM的优势和局限性。希望这些内容对您理解SVM有所帮助。如果您有任何问题或建议,欢迎在下方留言。