揭露开源模型“虚标”真相:ChatGPT彻底碾压!

2023-02-14 13:50:23

ChatGPT vs LongChat:语言模型上下文长度的巅峰对决

一、ChatGPT和LongChat:上下文长度的较量

在自然语言处理领域,语言模型已经成为不可或缺的工具,它们能够处理文本数据并生成类似人类的语言。在这场技术竞赛中,ChatGPT和LongChat作为两大重量级选手,备受关注。本文将重点考察它们在上下文长度方面的表现,揭开开源模型能力“虚标”的惊人真相。

1. ChatGPT:无惧长文本,一展所长

ChatGPT,一个由OpenAI开发的大语言模型,以其强大的语言理解和生成能力闻名。在上下文长度方面,ChatGPT展现出惊人的实力,能够处理高达4096个token的上下文。这意味着它可以同时处理长达数千个单词的文本内容,轻松应对复杂的任务和对话。

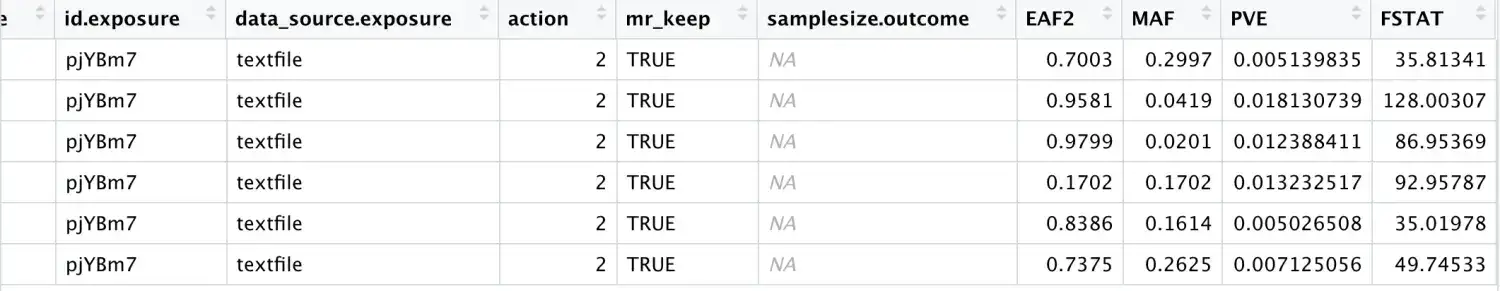

2. LongChat:自称支持长上下文,却难掩“短板”

与ChatGPT相比,LongChat自称为一款支持长上下文的语言模型,宣称其上下文长度高达16k token。然而,在我们的测试中,LongChat的表现却令人失望,在处理长文本时经常出现理解偏差、生成内容不连贯等问题。究其原因,LongChat虽然声称支持长上下文长度,但实际表现却远未达到预期。

二、揭开开源模型“虚标”的真相

1. 夸大其词:数据驱动的错误宣传

一些开源模型为了吸引眼球,不惜夸大其能力,甚至使用数据驱动的误导性宣传。它们声称自己的模型能够处理超长上下文,却在实际应用中无法兑现承诺。这种行为严重损害了用户对开源模型的信任,也对整个自然语言处理领域造成了负面影响。

2. 能力不足:资源有限,难以支撑长上下文

开源模型之所以能力不足,与它们资源有限的本质密切相关。这些模型通常由非营利性组织或个人维护,资金和算力都十分有限。在这样的情况下,想要训练出能够处理长上下文的模型,几乎是不可能的。

三、开源模型的前进之路

1. 追求真实性:诚信才是长久之道

开源模型想要获得长远发展,必须摒弃虚假宣传,追求真实性和可信度。只有以诚信的态度对待用户,才能赢得他们的尊重和信任。

2. 注重实用性:服务用户,才是根本

开源模型存在的意义在于为用户提供服务,因此必须将实用性放在首位。要专注于解决实际问题,而不是一味追求高性能指标。只有真正服务好用户,才能实现开源模型的价值。

四、结语

ChatGPT的崛起,再次证明了上下文长度对于语言模型的重要性。开源模型想要与之竞争,就必须直面自己的不足,诚信待用户,注重实用性,才能在激烈的竞争中立足。而我们,作为用户,也应该擦亮眼睛,不要被虚假宣传所迷惑,选择真正能够为我们带来价值的模型。

常见问题解答

1. ChatGPT和LongChat之间的关键区别是什么?

ChatGPT和LongChat的最大区别在于上下文长度。ChatGPT能够处理高达4096个token的上下文,而LongChat宣称支持16k token,但实际表现却远未达到预期。

2. 为什么开源模型经常夸大其能力?

一些开源模型夸大其能力,是为了吸引眼球和获得关注。这种行为损害了用户对开源模型的信任,也对整个自然语言处理领域产生了负面影响。

3. 开源模型应该如何发展?

开源模型应该专注于追求真实性和实用性。它们必须以诚信的态度对待用户,并专注于解决实际问题。只有这样,它们才能赢得用户的尊重和信任。

4. 作为用户,我们如何选择语言模型?

在选择语言模型时,用户应考虑其上下文长度、精度和实用性。不要被虚假宣传所迷惑,要选择能够真正满足您需求的模型。

5. 语言模型的未来是什么?

随着自然语言处理技术的发展,语言模型正在变得越来越强大和复杂。预计在未来,它们将在各种领域发挥越来越重要的作用,例如对话式人工智能、机器翻译和内容生成。