以数据为中心解决语义相似度计算的挑战

2023-09-18 23:51:41

自然语言处理(NLP)是人工智能的一个子领域,它专注于计算机与人类语言之间的交互。NLP的研究涵盖了广泛的主题,包括语义相似度、机器翻译、信息检索等。其中,语义相似度计算是NLP中的一项基本任务,它可以帮助计算机理解文本的含义,并执行各种NLP任务,例如文本分类、文本聚类、问答系统等。

近年来,以数据为中心的方法在NLP领域取得了巨大的成功。这种方法利用了大规模语料库和神经网络模型的强大功能,在各种NLP任务上取得了最先进的结果。语义相似度计算也不例外。

以数据为中心解决语义相似度计算挑战

语义相似度计算是一项挑战性任务,原因有很多。首先,文本的含义往往是模糊和不确定的。其次,文本的含义会随着上下文而变化。第三,不同的语言和文化对文本的理解也不尽相同。

以数据为中心的方法可以帮助解决这些挑战。首先,大规模语料库可以提供丰富的语义信息。其次,神经网络模型可以学习复杂的语义表示,这些表示可以捕获文本的含义。第三,通过使用不同的语料库和神经网络模型,我们可以构建适应不同语言和文化的语义相似度计算模型。

使用神经网络模型学习语义表示

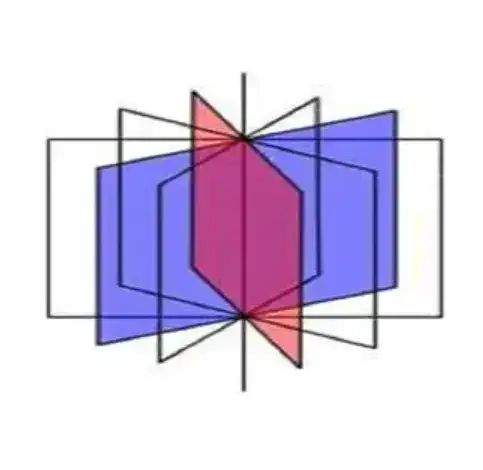

神经网络模型是一种强大的机器学习模型,它可以学习复杂的数据表示。在语义相似度计算任务中,我们可以使用神经网络模型来学习文本的语义表示。这些表示可以是词向量、句子向量或段落向量。

词向量是单词的语义表示。它可以捕获单词的含义、用法和同义词等信息。句子向量是句子的语义表示。它可以捕获句子的含义、结构和情感等信息。段落向量是段落的语义表示。它可以捕获段落的含义、主题和连贯性等信息。

使用语义表示计算文本相似度

一旦我们获得了文本的语义表示,我们就可以使用这些表示来计算文本之间的相似度。文本相似度计算方法有很多种,常见的方法包括:

- 余弦相似度 :余弦相似度是一种常用的文本相似度计算方法。它通过计算两个文本语义表示之间的余弦值来计算它们的相似度。余弦值越大,两个文本越相似。

- 欧氏距离 :欧氏距离是一种常用的文本相似度计算方法。它通过计算两个文本语义表示之间的欧氏距离来计算它们的相似度。欧氏距离越小,两个文本越相似。

- 曼哈顿距离 :曼哈顿距离是一种常用的文本相似度计算方法。它通过计算两个文本语义表示之间的曼哈顿距离来计算它们的相似度。曼哈顿距离越小,两个文本越相似。

使用大型数据集训练神经网络模型

为了构建准确和鲁棒的语义相似度计算模型,我们需要使用大型数据集来训练神经网络模型。大型数据集可以提供丰富的语义信息,帮助神经网络模型学习到更准确的语义表示。

目前,有许多大型语料库可供使用,例如:

- 维基百科 :维基百科是一个自由的网络百科全书,它包含了数百万篇高质量的文章。

- 谷歌图书 :谷歌图书是一个数字图书馆,它包含了数百万本图书。

- 推特 :推特是一个社交媒体平台,它包含了数十亿条推文。

我们可以使用这些大型语料库来训练神经网络模型,构建准确和鲁棒的语义相似度计算模型。

使用语义相似度计算模型解决各种NLP任务

语义相似度计算模型可以用于解决各种NLP任务,例如:

- 文本分类 :文本分类是将文本分为预定义的类别。语义相似度计算模型可以帮助我们确定文本与每个类别的相似度,并将其分类到最相似的类别。

- 文本聚类 :文本聚类是将文本分组到具有相似语义的组中。语义相似度计算模型可以帮助我们确定文本之间的相似度,并将其聚类到具有相似语义的组中。

- 问答系统 :问答系统是回答用户问题的人工智能系统。语义相似度计算模型可以帮助我们确定用户问题与候选答案之间的相似度,并返回最相似的答案。

语义相似度计算模型在NLP领域有着广泛的应用。随着以数据为中心方法的不断发展,语义相似度计算模型的准确性和鲁棒性将进一步提高,并将在NLP领域发挥越来越重要的作用。