揭开 GRL 的神秘面纱:一篇来自白给者的深度解析

2023-12-22 19:39:42

DaNN 论文重读之旅:深入探究梯度反转层 (GRL) 的真谛

引言

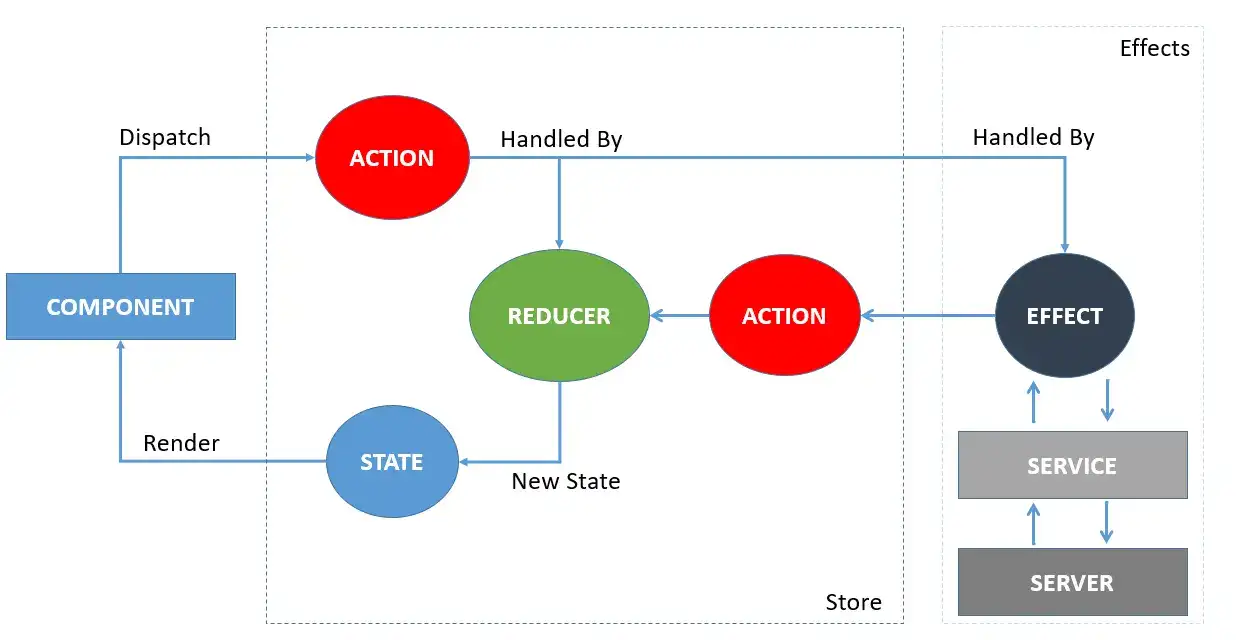

领域适应,作为机器学习领域一门备受瞩目的前沿技术,旨在让模型突破对单一领域数据的依赖,应对现实世界中复杂多变的数据分布。在众多领域适应方法中,DaNN 论文无疑是领域适应研究领域的一座丰碑,它首次提出了梯度反转层 (GRL)这一巧妙的技巧,为后续研究奠定了坚实的基础。本文将带您重温 DaNN 论文,深入探索 GRL 的思想内涵,并分享其在实践中的应用。

领域适应:挑战与机遇

传统的机器学习模型通常依赖于特定领域的大量标记数据进行训练,当应用于不同领域时,模型的性能往往会大幅下降。这一现象被称为领域差异 ,主要源于不同领域之间数据分布的差异,包括数据特征、标签分布以及数据之间的相关性等。

领域适应技术应运而生,旨在克服领域差异的挑战,使模型能够在不同领域的数据上有效学习和泛化。这不仅为解决实际应用中的问题提供了新的途径,也为机器学习理论研究开辟了广阔的前景。

DaNN 论文:GRL 的诞生

2015 年,Ganin 等人发表了 DaNN 论文,首次提出了梯度反转层 (GRL)这一巧妙的技巧。GRL 的核心思想很简单,却极具创造性:在模型中引入一个梯度反转层,迫使模型在源领域的数据上学习到的特征与目标领域的数据上学习到的特征相互冲突。

具体而言,GRL 会将源领域数据的梯度反转,然后再反向传播到模型中。这样做的目的是让模型在源领域上学习到的特征与目标领域上的特征尽可能不同。这就好比在模型的学习过程中,人为地制造了两个对立的目标,让模型在权衡和平衡这两个目标的过程中,逐渐习得跨领域迁移的能力。

GRL 的优势与局限

作为一种无监督领域适应方法,GRL 具有以下优势:

- 无需目标领域标签: GRL 不需要目标领域的数据标签,这在实际应用中非常实用,因为获取标签往往成本高昂且耗时。

- 易于实现和部署: GRL 只需在模型中添加一个梯度反转层即可,实现和部署非常方便。

然而,GRL 也存在一定的局限性:

- 可能难以处理差异较大的领域: GRL 对于差异较大的领域之间的迁移可能难以有效。

- 对超参数敏感: GRL 的效果对超参数的设置比较敏感,需要根据具体任务进行调整。

GRL 的应用场景

GRL 在许多领域都有着广泛的应用,包括:

- 图像分类: 将模型在 ImageNet 数据集上学习到的知识迁移到其他领域的图像数据集,如医疗图像数据集或遥感图像数据集。

- 自然语言处理: 将模型在某个领域训练好的文本分类器迁移到其他领域的文本分类任务,如新闻分类或社交媒体文本分类。

- 语音识别: 将模型在一个语言上训练好的语音识别系统迁移到其他语言的语音识别任务。

代码示例

以下代码示例展示了如何使用 TensorFlow 实现一个包含 GRL 的领域适应模型:

import tensorflow as tf

# 定义模型

model = tf.keras.models.Sequential([

tf.keras.layers.Dense(1024, activation='relu'),

tf.keras.layers.Dense(1024, activation='relu'),

tf.keras.layers.Dense(10, activation='softmax')

])

# 定义梯度反转层

grl = tf.keras.layers.Lambda(lambda x: -x)

# 将模型与 GRL 结合

source_output = model(source_data)

target_output = grl(model(target_data))

# 定义损失函数和优化器

loss = tf.keras.losses.categorical_crossentropy(target_output, target_labels)

optimizer = tf.keras.optimizers.Adam(learning_rate=0.001)

# 训练模型

model.compile(optimizer=optimizer, loss=loss)

model.fit([source_data, target_data], target_labels, epochs=10)

常见问题解答

Q1:GRL 与对抗训练有什么区别?

GRL 和对抗训练都是通过引入对立目标来提高模型的泛化能力。然而,GRL 主要是针对领域适应问题,而对抗训练则更广泛地应用于各种机器学习任务。

Q2:GRL 可以与其他领域适应方法结合使用吗?

是的,GRL 可以与其他领域适应方法结合使用,如自适应特征对齐 (AdaBN) 和最大均值差异 (MMD)。这种结合可以进一步提高模型的领域适应性能。

Q3:如何选择 GRL 的超参数?

GRL 的超参数包括反转系数和训练步数。反转系数控制梯度反转的程度,而训练步数决定 GRL 的训练时间。这些超参数需要根据具体任务进行调整。

Q4:GRL 对模型的架构有什么要求?

GRL 对模型的架构没有严格要求,可以应用于各种神经网络模型,如卷积神经网络 (CNN) 和循环神经网络 (RNN)。

Q5:GRL 在哪些领域有实际应用?

GRL 已被成功应用于图像分类、自然语言处理、语音识别和医疗诊断等多个领域。

结论

DaNN 论文中提出的梯度反转层 (GRL) 是领域适应研究领域的一项开创性贡献。GRL 的思想简单却强大,它迫使模型在不同领域的数据上学习到的特征相互冲突,从而提高模型的跨领域迁移能力。虽然 GRL 存在一定的局限性,但它依然是领域适应研究中的一个重要技术,并激发了后续研究的创新。随着领域适应技术的不断发展,我们相信 GRL 将在更多领域发挥重要作用,为人工智能的进步和普惠化做出贡献。