揭秘ChatGPT架构师的语言大模型理论:多模态性能背后的真相

2023-06-06 10:28:29

大模型的多模态能力:开启人工智能新篇章

一、多模态能力:数据交融,赋能大模型

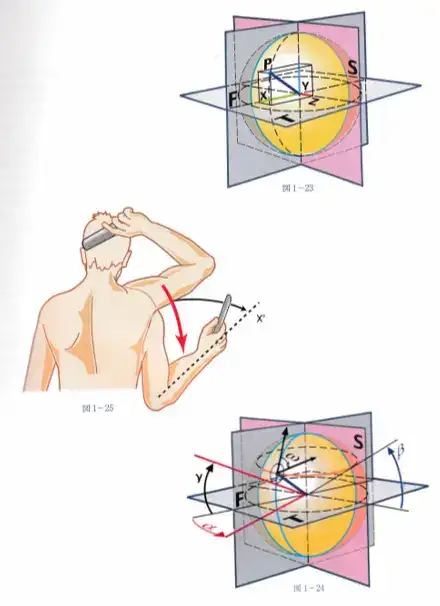

想象一下,一台机器能够同时处理文字、图像、声音和视频,并从这些数据中提取有意义的信息。这正是多模态能力赋予大模型的独特优势。大模型能够超越单一数据类型的限制,获得对世界的全面理解。

二、多模态能力对性能的提升:全面、高效、创新

添加多模态功能可以显著提升大模型的性能,具体体现在以下方面:

- 全面理解世界 :通过处理各种数据类型,大模型可以构建一个更全面的世界观,并做出更准确的判断。

- 高效解决问题 :大模型可以灵活组合不同类型的数据,找到解决问题更有效的方法。

- 激发创新 :通过交叉融合不同数据,大模型能够产生更加新颖和创造性的想法。

三、ChatGPT架构师John Schulman的研究经验:多模态大模型的先驱

作为人工智能领域的先驱,John Schulman在多模态大模型的研究方面取得了丰硕成果。他提出的Transformer-XL架构,能够有效处理长文本数据,在文本生成和机器翻译等任务上表现出色。

此外,Schulman还提出了ViT架构,专注于图像数据的处理,在图像分类和目标检测任务上取得了突破性进展。他的研究为多模态大模型的发展奠定了坚实的基础。

四、大模型的未来发展方向:智能、通用、易用

随着人工智能技术不断进步,大模型正迈向更广阔的未来:

- 更加智能 :大模型将变得更聪明,能够理解和分析更复杂的数据,做出更可靠的决策。

- 更加通用 :大模型将扩展其能力,处理更多的不同数据类型和任务,成为真正的全能型选手。

- 更加易用 :大模型将变得更加友好,普通人也可以轻松地使用它来完成任务和解决问题。

代码示例:

import transformers

# 创建一个多模态大模型

model = transformers.AutoModelForSeq2SeqLM.from_pretrained("facebook/blenderbot-400M")

# 输入文本和图像

text = "这幅画里画的是什么?"

image = transformers.Image.from_path("image.jpg")

# 融合文本和图像数据,生成响应

inputs = transformers.Seq2SeqInput(input_ids=text, input_image=image)

outputs = model.generate(inputs)

# 输出响应文本

print(outputs[0])

常见问题解答

1. 多模态能力如何影响ChatGPT的文本生成能力?

多模态能力允许ChatGPT同时处理文本和图像,从而生成更具连贯性和生动性的文本。

2. 多模态大模型在医疗保健领域有何应用?

多模态大模型可以分析医疗图像和文本数据,辅助医生诊断和预测疾病。

3. 多模态大模型的训练成本是否很高?

是的,多模态大模型的训练通常需要大量的计算资源和数据。

4. 多模态大模型是否存在偏见问题?

由于训练数据中可能存在的偏见,多模态大模型也可能产生带有偏见的输出。

5. 未来多模态大模型的发展方向是什么?

未来多模态大模型将变得更加智能、通用和易用,并将在各个领域发挥更大的作用。

结论

大模型的多模态能力正在推动人工智能发展迈入新阶段。ChatGPT架构师John Schulman的研究经验为我们指明了未来的方向。随着人工智能技术的持续进步,多模态大模型将继续释放其潜力,为我们带来更加智能和便捷的生活。