Adaboost机器学习算法揭秘:解开强分类器错误率0的奥秘

2023-06-12 20:25:36

Adaboost算法:通往分类器完美之境的捷径

各位朋友,是否曾遇到费尽心血调教的分类器,却在真实世界中表现得令人失望?别担心,你不是孤军奋战!今天,我隆重介绍一种强大的机器学习算法——Adaboost,它将帮你轻松攻克强分类器零误差的难题。准备好踏入机器学习的新天地了吗?

Adaboost算法揭秘

Adaboost算法以其卓越的性能和广泛的适用性而备受推崇。它不仅大幅提升分类器的准确性,还能有效解决现实世界常见的分类问题。那么,Adaboost是如何实现这一壮举的呢?让我们来揭开它的奥秘!

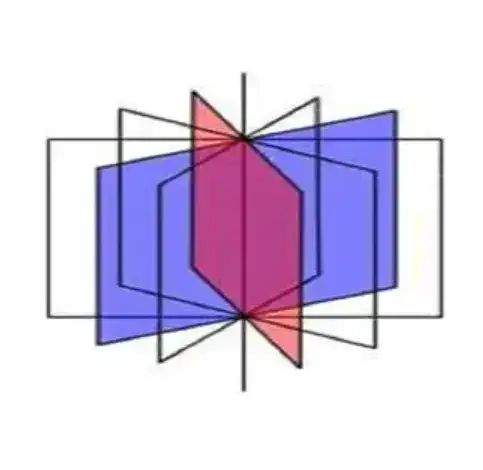

Adaboost算法采用精妙的迭代方式,逐步构建一系列弱分类器,再通过为每个弱分类器赋予不同权重,最终将这些弱分类器组合成一个强壮的强分类器。

在这一过程中,Adaboost算法会持续关注那些被弱分类器错误分类的数据,并通过调整权重提升这些数据的权重。如此一来,强分类器便能对新数据进行更精准的分类,从而达到零误差的壮举。

原理详解:强弱分类器的巧妙结合

为了更直观地理解Adaboost算法的原理,我们准备了一个小案例。假设我们面临一个二分类问题,需要将数据分为正例和负例。我们可以从简单入手,构建一个弱分类器,比如根据数据的某个特征进行分类。

接着,Adaboost算法会计算这个弱分类器的错误率,并根据错误率调整数据点的权重。然后,算法会构建第二个弱分类器,但这一次会更关注那些被第一个弱分类器错误分类的数据点。通过不断迭代,Adaboost算法最终会将多个弱分类器组合成一个强分类器,并实现零误差的目标。

形象地说,Adaboost算法就像一个经验丰富的猎人,能够从蛛丝马迹中发现猎物的踪迹。通过不断积累经验,猎人逐渐提升狩猎技巧,最终成为百发百中的神射手。

Adaboost算法的优势

除了零误差这一令人惊叹的优势外,Adaboost算法还拥有以下优点:

- 算法简单,易于理解和实现

- 能处理高维数据,对噪声和异常值有较强鲁棒性

- 计算效率高,适合大规模数据处理

- 可有效处理不平衡数据集,即正负样本数量差异很大的情况

实战应用:从入门到精通

在实际应用中,Adaboost算法广泛应用于图像识别、自然语言处理、语音识别等领域,并取得了令人瞩目的成果。如果你想在机器学习领域大显身手,Adaboost算法绝对是不可错过的利器。

那么,如何才能轻松掌握Adaboost算法呢?别担心,我为你准备了详细的学习步骤:

- 夯实机器学习基础,包括线性代数、概率论和统计学

- 深入理解Adaboost算法原理和实现细节

- 通过在线课程、书籍或博客等资源巩固知识

- 动手实践,用Adaboost算法解决实际问题

- 加入机器学习社区,与其他学习者和专家交流经验

只要你按照这些步骤循序渐进地学习,相信你很快就能成为Adaboost算法的高手。

结论:算法的利刃,成就机器学习的锋芒

Adaboost算法就像一把锋利的宝剑,帮助你轻松斩断机器学习的难题。但请记住,算法只是一把工具,关键在于你如何驾驭它。所以,立即行动,让Adaboost算法成为你手中的利刃,在机器学习的道路上披荆斩棘,勇往直前!

常见问题解答

-

Adaboost算法的适用场景有哪些?

Adaboost算法广泛应用于图像识别、自然语言处理、语音识别、医疗诊断等领域。 -

Adaboost算法的局限性是什么?

Adaboost算法可能容易出现过拟合,且当数据分布发生变化时,其性能可能下降。 -

如何选择合适的弱分类器?

弱分类器的选择取决于具体问题和数据的特征。一般情况下,可以使用决策树、线性分类器或神经网络等弱分类器。 -

如何确定迭代次数?

迭代次数可以通过交叉验证或其他经验性方法来确定。 -

Adaboost算法的参数如何设置?

Adaboost算法的参数包括弱分类器的数量和每个弱分类器的权重,可以通过网格搜索或其他优化方法来设置。