TensorFlow 中控制流的实现

2023-09-08 23:04:50

TensorFlow 的控制流:揭秘深度学习的灵活性

在深度学习领域,TensorFlow 凭借其灵活性和可扩展性脱颖而出。而这一切都要归功于它强大的控制流机制,它允许我们构建复杂的模型,在训练和推理过程中进行分支和循环。让我们深入探讨控制流在 TensorFlow 中的实现,了解它如何赋予我们掌控计算流的力量。

TensorFlow 的控制流基础

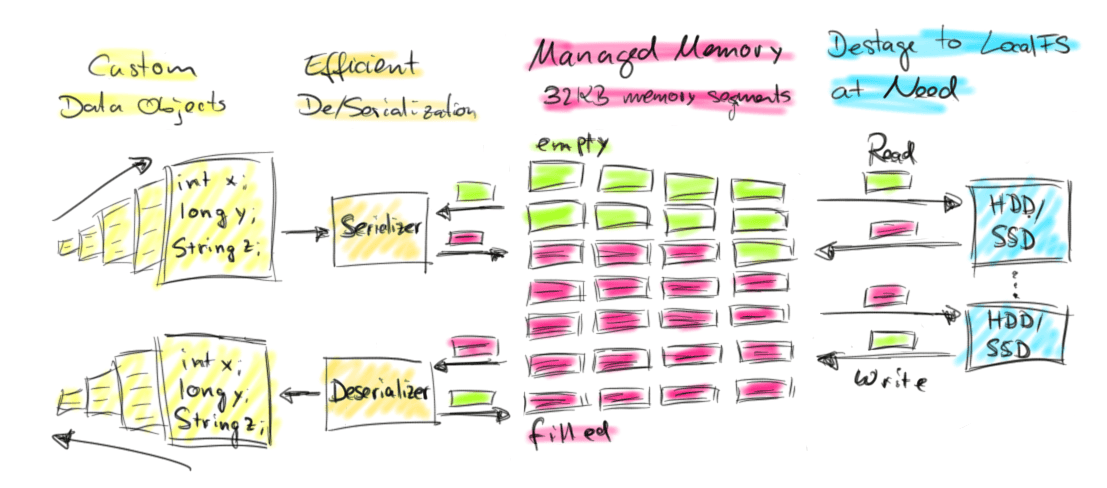

TensorFlow 将控制流视为有向无环图(DAG),其中节点表示操作,而边表示数据依赖关系。为了在 DAG 上执行控制流,TensorFlow 采用了以下关键技术:

Switch 和 Merge 算子: 就像交通警察,这对算子将数据流引导到不同的路径,实现分支和汇合。

Enter 和 Exit 算子: 它们定义了循环的边界,确保数据在循环内正确流动。

Next Iteration 算子: 这个算子就像接力棒,将数据从循环的末尾传递到下一迭代的开头。

控制流结构:

通过组合这些算子,TensorFlow 实现了一系列控制流结构:

条件语句: 使用 Switch 和 Merge 算子根据条件将数据流引导到不同的分支。

循环语句: 使用 Enter、Exit 和 Next Iteration 算子创建循环结构,在指定次数或条件满足时重复执行代码块。

并行执行: 使用并行 DAG 结构,同时执行多个操作。

代码示例:

import tensorflow as tf

# 条件语句

x = tf.placeholder(tf.float32)

y = tf.placeholder(tf.float32)

z = tf.placeholder(tf.float32)

condition = tf.greater(x, y)

output = tf.cond(condition, lambda: tf.add(x, z), lambda: tf.subtract(x, z))

# 循环语句

i = tf.constant(0)

result = tf.constant(0)

def cond(i, result):

return tf.less(i, 10)

def body(i, result):

result = tf.add(result, i)

i = tf.add(i, 1)

return i, result

_, result = tf.while_loop(cond, body, [i, result])

意义和影响:

TensorFlow 中控制流的实现彻底改变了深度学习的格局,使其:

- 分布式训练成为可能: 控制流允许在分布式系统上并行训练大规模模型。

- 推动了动态图执行: 控制流允许在训练过程中动态修改计算图,实现自适应学习和推理。

- 增强了可解释性: 控制流有助于理解模型的行为和决策过程,提高神经网络的可解释性。

结论:

TensorFlow 的控制流机制是一项复杂而巧妙的技术,它赋予了我们构建更复杂、更灵活的深度学习模型的能力。从条件语句到循环结构,它为我们提供了对计算流的完全控制,释放了创新和探索的无限潜力。

常见问题解答:

- 控制流和数据流有什么区别?

控制流决定了计算的顺序,而数据流决定了数据在计算图中的流动。

- 什么是并行执行?

并行执行允许同时执行多个操作,以提高计算效率。

- 循环结构如何工作?

循环结构使用 Enter 和 Exit 算子定义循环的范围,Next Iteration 算子将数据从循环的末尾传递到下一迭代的开头。

- TensorFlow 如何优化控制流性能?

TensorFlow 使用循环展开和并行执行等技术来优化控制流性能。

- 控制流在深度学习中的重要性是什么?

控制流允许我们构建更复杂、更灵活的模型,执行分支、循环和并行操作,以提高性能和可解释性。