LLaMA 2 Transformer结构深度解析

2023-03-29 04:36:30

深入探究 LLaMA 2 Transformer 结构:解锁自然语言处理的力量

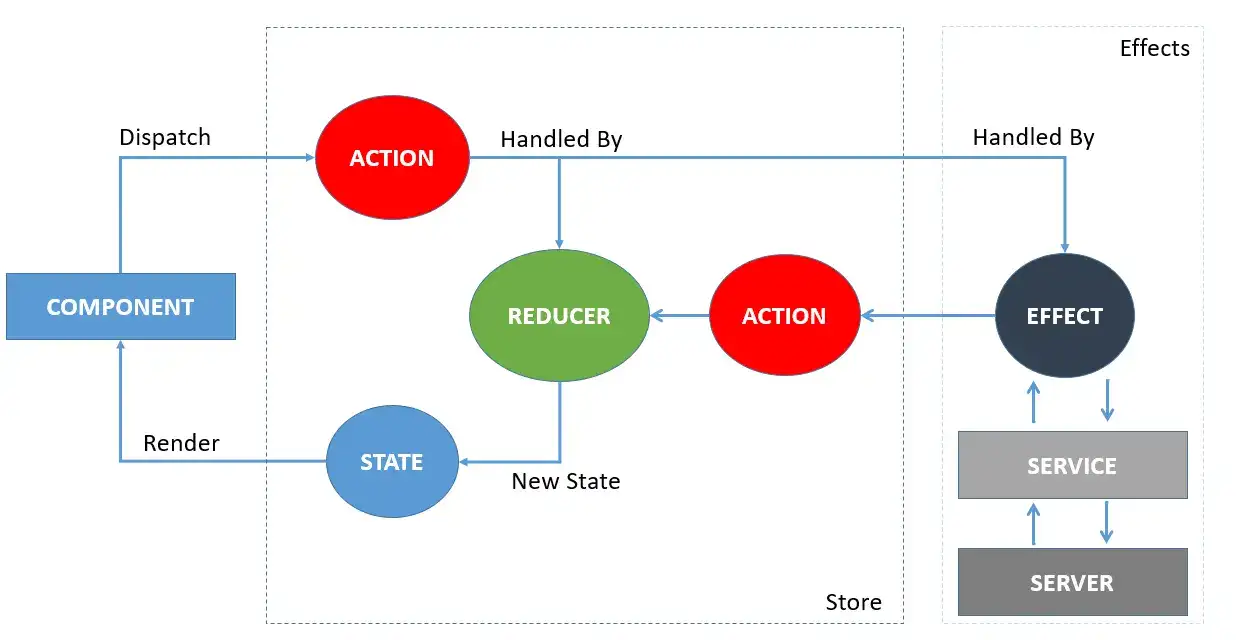

概述:LLaMA 2 Transformer 结构

LLaMA 2 Transformer 结构是一个突破性的深度学习模型,它基于 Transformer 架构,专门用于处理序列数据,例如文本。它以其强大的能力而著称,能够理解和生成人类语言。

组成部分:

- 编码器: 将输入序列转换为固定长度向量的模块。

- 解码器: 将编码器生成的向量转换为输出序列的模块。

- 输出层: 将解码器生成的向量转换为最终输出的模块。

训练:

LLaMA 2 Transformer 结构通常使用海量的无监督数据进行训练,无需人工标签。这些数据集包含数十亿个文本样本,让模型学习语言的复杂性和模式。

应用:

LLaMA 2 Transformer 结构在自然语言处理领域具有广泛的应用,包括:

- 机器翻译

- 文本摘要

- 文本分类

- 文本生成

优势:

LLaMA 2 Transformer 结构以其高性能和处理复杂文本的能力而著称。它使用注意力机制,使其能够专注于序列中重要的元素,并了解它们之间的关系。

用例:

LLaMA 2 Transformer 结构已成功用于各种应用,包括:

- Google 翻译中的机器翻译

- Facebook 中的文本摘要

- 微软 Word 中的文本分类

- OpenAI 中的文本生成

代码示例:

import transformers

# 加载 LLaMA 2 Transformer 模型

model = transformers.AutoModelForSeq2SeqLM.from_pretrained("google/llama-2-large")

# 输入序列

input_sequence = "This is a sample input sequence."

# 使用模型生成输出序列

output_sequence = model.generate(input_sequence)

# 打印输出序列

print(output_sequence)

常见问题解答:

-

LLaMA 2 Transformer 结构与其他 Transformer 模型有什么不同?

LLaMA 2 Transformer 结构经过大量无监督数据的训练,使它能够处理更复杂的文本并生成更流畅的文本。 -

LLaMA 2 Transformer 结构的训练需要多长时间?

训练 LLaMA 2 Transformer 结构需要大量的计算资源和时间,通常需要数周或数月。 -

LLaMA 2 Transformer 结构的准确率如何?

LLaMA 2 Transformer 结构在各种自然语言处理任务上表现出很高的准确率,在机器翻译和文本生成方面尤其出色。 -

LLaMA 2 Transformer 结构是否可以用于商业用途?

LLaMA 2 Transformer 结构已获得许可,可用于商业用途,但需要遵守 Google 的使用条款。 -

LLaMA 2 Transformer 结构的未来是什么?

LLaMA 2 Transformer 结构仍处于开发阶段,预计未来将继续得到改进和增强,使其在自然语言处理领域发挥更大的作用。

结论:

LLaMA 2 Transformer 结构是自然语言处理的突破性进步。它具有理解和生成人类语言的强大能力,使其成为各种应用中不可或缺的工具。随着持续的研究和开发,LLaMA 2 Transformer 结构有望在未来彻底改变我们与计算机互动的方式。